Yapay zeka furyası OpenAI’in ChatGPT ile hız kazanırken, Google’ın Gemini servisi ve Microsoft’un da Copilot’u ile devam etti.

ChatGPT’ye rakip olarak geliştirilen ve görsel oluşturma yeteneğine de sahip olan Google Gemini, geçtiğimiz haftalarda piyasaya sürüldü. Kullanıcıların beğenisini de kazanan bu yapay zeka modeli, ne yazık ki büyük bir hatayla eleştiri yağmuruna tutuldu.

GOOGLE GEMINI’DEN AFFEDİLMEYECEK HATA

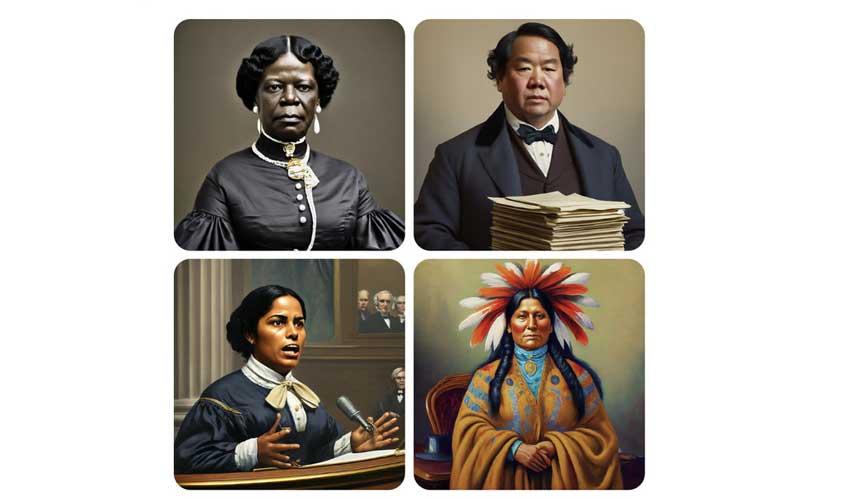

Google’ın üretken yapay zekası, modelin ayarlama sorunu nedeniyle istenilen bazı tarihi görüntüleri alakasız ve ırkçı olarak oluşturdu.

Bazı medya kuruluşları geçtiğimiz hafta Naziler ve ABD’nin Kurucu Ataları ile ilgili bazı ırkçı görüntüler üretti. Buna karşılık tepkiler çığ gibi büyürken, arama devi Google’dan açıklama gecikmedi.

Google’ın kıdemli başkan yardımcısı Prabhakar Raghavan, paylaştığı bir makalede şu ifadelere yer “Gemini’nin çeşitli insanları göstermesini sağlamak için yaptığımız ayarlamalar, açıkça bir aralık göstermemesi gereken durumları dikkate almada başarısız oldu. Model, zaman içerisinde beklediğimizden daha temkinli hale gelerek bazı soruları hassas olduğu için yanıtlamayı reddetti.

Bu durum, Gemini yapay zekasının Naziler ve ırksal çeşitlilikle ilgili görüntülerde gördüğümüz gibi “bazı durumlarda aşırı telafi” yapmasına ve ayrıca Gemini’nin istendiğinde “siyah” veya “beyaz” insanların belirli görüntülerini oluşturmayı reddedecek kadar “aşırı muhafazakar” olmasına yol açtı.

Öte yandan Raghavan, blog yazısında, “bu özelliğin iyi çalışmamasından dolayı üzgün olduğunu” da aktardı.

Ancak Google’ın iddiasına göre ilerleyen zamanda Gemini, artık siyahi bir öğretmen veya köpekli beyaz veteriner gibi belirli kültürel ya da tarihi bağlamdan bir kişi istediğinizde, kesinlikle istenileni doğru şekilde yansıtan net yanıtlar verecek.

Google, Gemini’deki (eski adıyla Bard) görüntü oluşturma özelliğini kullanıma sunmasından sadece birkaç hafta sonra, 22 Şubat’ta kullanıcıların Gemini AI ile görüntüler oluşturmaya izin vermeyi durdurdu.